Ray-Ban mit Kamera: Das macht die KI-Brille mit Euren Fotos

Die aktuelle Ray-Ban-Brille von Meta ist mit einer integrierten Kamera ausgestattet und schafft den Spagat zwischen Mode und Technologie. Das Design ist cool, und die Hardware für Content Creator spannend. Es bleibt aber ein ungutes Gefühl und die Fragen: Was passiert mit den Bildern und Videos, die die Brille aufzeichnet? Wie nutzt Meta diese Daten?

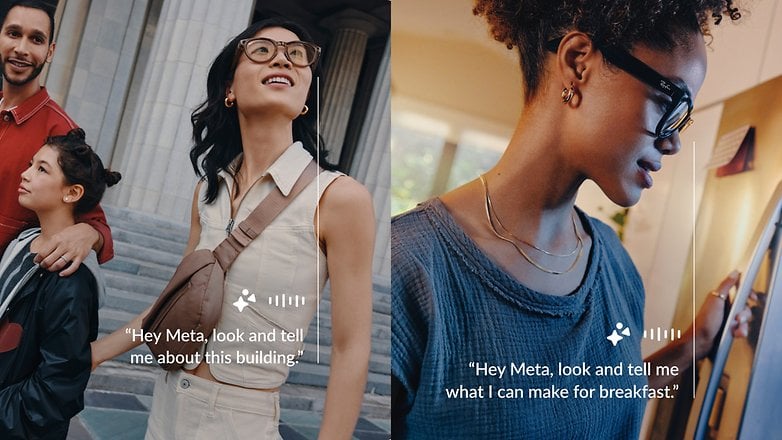

Meta, die Muttergesellschaft hinter Facebook, Instagram und WhatsApp, ist bekannt dafür, innovative Technologien zu entwickeln, die die Art und Weise verändern, wie wir kommunizieren und interagieren – und hier auch mal Grenzen zu überschreiten. Mit der aktuellen Brille, die in Zusammenarbeit mit Ray-Ban entstanden ist, zielt das Unternehmen darauf ab, durch künstliche Intelligenz im Alltag einen echten Mehrwert zu schaffen. Diese Brille kann nämlich auch Bilddaten aus der Umgebung nutzen, um kontextbezogene Informationen oder Empfehlungen zu liefern.

Die dunkle Seite der Datenverarbeitung

Eine der zentralen Fragen, die sich stellt, ist, wo die meisten dieser Bilddaten verarbeitet werden. Die Antwort: Die Bilddaten werden mangels lokal verfügbarer Rechenpower nicht auf dem Gerät selbst, sondern auf den Cloud-Servern von Meta ausgewertet. Das ermöglicht einerseits natürlich viel spektakulärere Features, wirft aber auch Bedenken hinsichtlich der Datenschutzpraktiken auf.

Die in die Cloud geschickten Informationen werden nämlich nicht einfach nur ausgewertet, sondern auch für das Training von KI-Modellen genutzt – und bleiben damit in irgendeiner Art und Weise gespeichert. Wieso das problematisch sein kann, zeigte ein Paper, an dem auch Google Deepmind beteiligt war. Hier gelang es den Forschern, Trainingsdaten aus einem KI-Modell von OpenAI durch geschicktes Prompting zu extrahieren.

Bilddaten als KI-Trainingsmaterial

Gegenüber Techcrunch hat Meta nun bestätigt, dass die Bild- und Videodaten zum Training der Meta AI genutzt werden – allerdings nur, wenn die User auch tatsächlich die hauseigene Meta AI benutzen. Und das soll auch nur für jene Aufnahmen gelten, die die Anwender tatsächlich durch die KI analysieren lassen. Was in dem offiziellen Statement von Meta so klar und transparent klingt, wird in der Praxis aber wohl in langen ToS-Bleiwüsten und komplizierten Menüs versteckt sein – es wäre zumindest nicht das erste Mal.

Aktuell gilt das freilich nur für die USA und Kanada, denn hierzulande sind die KI-Features noch gar nicht verfügbar. Die strengen Datenschutzbestimmungen in Europa werden zwar zu höheren Anforderungen führen, aber die Fragen bleiben: Wie lässt sich wirklich sicherstellen, dass einmal freigegebene Daten nicht missbraucht werden? Und wie lässt sich in der Praxis feststellen, was tatsächlich in der Cloud landet und was nicht?

- Weiterlesen: Das kann Metas Ray-Ban-Brille mit Kamera und KI-Features

Die Verantwortung von Meta

Meta hat die Verantwortung, transparent zu kommunizieren, wie die Datenverarbeitung funktioniert und wie unsere Daten geschützt werden. In einer Zeit, in der Datenschutz zu einem zentralen Anliegen geworden ist, müssen Nutzer aufgeklärt und empowered werden, um informierte Entscheidungen darüber zu treffen, wie und wann sie ihre Daten teilen. Die fortschreitende Integration von Technologie in unser tägliches Leben sollte nicht auf Kosten unserer Privatsphäre gehen.

In einer Welt, in der Technologie und Lifestyle zunehmend miteinander verschmelzen, ist es entscheidend, dass wir alle als Nutzer ein kritisches Auge auf die Produkte haben, die wir verwenden. Die Ray-Ban-Brille von Meta ist nur der Anfang einer neuen Ära, in der Daten und persönliche Informationen eine Schlüsselrolle spielen. Und die Brille ist dafür gemacht, privatere Daten denn je zu teilen.

Auf der einen Seite ist es mittlerweile nicht mehr möglich, auf dem Handy einen einfachen Screenshot eines Whatsapp*-Profilbildes zu erstellen, das der/die andere ja freiwillig veröffentlicht hat, auf der anderen Seite aber sollte man andere heimlich filmen können (dürfen sowieso nicht, aber wen schert das)

Man sollte sich so einen Kauf vorab sehr gut überlegen*, weil ich denke, dass die Hersteller gesetzlich bald zurecht mittels Update angehalten werden, zB Gesichter bei der Aufnahme mittels Software automatisch unkenntlich zu machen und Stimmen zu verzerren. Jedenfalls wünsche ich mir das noch vor dem Marktstart.

* BTW: Whatsapp nimmt den Datenschutz auf einmal sehr genau, allerdings nur jenen zwischen den einzelnen Usern, den konzerninternen vermutlich eher nicht.

Mich würde es alleine schon kolossal nerven, wenn ich künftig ständig darauf achten müsste, ob es sich bei den Brillen der Brillenträger im Raum um ganz normale Brillen handelt oder ob da eine LED dran ist, die womöglich auch noch blinkt. Ich darf erwarten, nicht ungefragt gefilmt zu werden und sollte mich nicht auch noch aktiv darum kümmern müssen, das in Erfahrung zu bringen. Ich fürchte, Brillenträger werden künftig dann wohl mehr gemieden werden, sollten sich solche Brillen auf dem Markt durchsetzen.

Die wesentliche Problematik solcher Brillen sehe ich nicht mal in den Daten des Käufers, der sich mit den Datenschutzrichtlinien befassen kann, und im Zweifelsfall den Kauf auch unterlassen, oder die Nutzung der Brille darauf abstimmen kann. Für ein größeres Problem halte ich, dass sich auch Aufnahmen Dritter ungefragt anfertigen und zur Analyse in die Cloud schicken lassen. Damit würde deren Recht am eigenem Bild verletzt. Im Grunde müsste die KI die Speicherung und Verarbeitung von Videos oder Bildern, in deren Mittelpunkt Personen stehen, ablehnen, da sich nicht sicherstellen lässt, dass die Zustimmung der gefilmten Personen tatsächlich vorliegt.

Das "coole Design" der Brille ist dabei eher kontraproduktiv.

Da sich die Brille kaum von einer normalen Sehhilfe unterscheidet, wird es für ungefragt gefilmte Personen schwieriger, den Vorgang zu erkennen und sich ihm zu entziehen oder die Löschung der Aufnahmen zu verlangen. Eine bei Aufnahmen rot blinkende LED oder Ähnliches, die sich im hellen Sonnenschein aus einigen Metern kaum noch erkennen lässt, dürfte da wenig hilfreich sein.

So gesehen müssten dann auch Smartphonebilder abgelehnt werden, oder generell alle Bilder und Filme. Denn die KI weiß bei keinem Bild- und Fotomaterial, ob eine Genehmigung der abgelichteten Personen vorliegt (Für sie selber, und ggf. für dessen Eigentum wie z.B. die Wohnung oder der Garten).

Im Grunde ja. Aber wenn ein Smartphone permanent auf jemand gerichtet ist, kann die gefilmte Person davon ausgehen, dass sie möglicherweise ungefragt gefilmt wird, und den Filmenden zur Rede stellen, oder sich der Szenerie zumindest entziehen.

Auch die "Google Glass" war wegen ihres Designs leicht zu erkennen. Die Möglichkeit, damit ungefragt gefilmt zu werden hat für erhebliche Unruhe gesorgt, ihre Träger mussten sie teilweise in Lokalen abnehmen usw. und der so entstandene soziale Druck auf ihre Träger hat die Sache dann schnell erledigt.

Diese Möglichkeiten, sich gegen ungewolltes Filmen zu wehren entfallen aber, wenn man die Brille gar nicht als fotografier- und filmfähiges Gadget erkennt, weil sie einer ganz gewöhnliche Sehhilfe zum Verwechseln ähnlich sieht. Der Schutz der Persönlichkeitsrechte Dritter erfordert also Maßnahmen, die über bisherige Schutzmaßnahmen hinausgehen, da es bisher zwar nicht unmöglich, aber nur schwieriger möglich war, Personen heimlich zu filmen.

>>>ihre Träger mussten sie teilweise in Lokalen abnehmen usw.<<<

... versetzt euch doch mal in die Damenwelt in Sauna oder Schwimmbad etc... da wird das Problem noch deutlicher.

Ja, oder noch schlimmer, wenn kleine Kinder am Spielplatz oder am Strand einfach von irgendwelchen Leuten gefilmt werden, die nichts mit ihnen zu tun haben. Auch beim Mobbing unter Schülern spielen heimliche Videoaufnamen eine wichtige Rolle.

Deshalb könnte KI, die solche Aufnahmen erkennt, die Speicherung und Weiterverarbeitung erst dann ermöglichen, wenn die aufgenommenen Personen mittels einer Art Videoidentverfahren zuvor ihre Zustimmung dafür erteilt haben. Die legale Aufnahme von Angehörigen für's Familienalbum würde das natürlich wieder stark verkomplizieren, eine ideale Lösung wäre das also auch nicht.

Allerdings hielt ich die Sperrung von Aufnahmen bei fehlender Zustimmung allemal besser, als Millionen Smartphones anlasslos nach pädokriminellem Material zu durchsuchen.

Ein erweiterter "magischer Radierer" könnte zudem automatisch Personen aus Aufnahmen entfernen, die zufällig mit aufgenommen wurden, und gar nicht im Zentrum der Aufnahme stehen, auch wenn das dann gar nicht unbedingt nötig ist, und die Authentizität der Aufnahme negativ beeinflusst.

Ich sehe für mich keinen Nutzen in solchen Brillen. Mal davon abgesehen, dass ich bereits eine Sehhilfe trage. Da bräuchte es einen Clip-Aufsatz mit passend geschliffenen Gläsern, damit der Aufsatz auch zu den vorhandenen Gläsern passt (dumm wenn man nach zwei Jahren eine neue Sehhilfe mit anderer Glasform braucht).

Ja gut, dann muss man halt auf Kontaktlinsen ausweichen, das ist ja heutzutage kein großes Ding mehr. Und wer das nicht kann oder mag, muss dann eben auf so eine Brille verzichten.

Ich kann keine Kontaktlinsen tragen, da das bei Winkelfehlsichtigkeit nicht geht. Aber ich verzichte gern auf solche KI-Brillen.