Computational RAW auf Smartphones: das Beste aus zwei Welten

Das RAW-Format ist aus der Digitalfotografie mit dedizierten Kameras nicht wegzudenken. Bei Smartphones spielt es dagegen nahezu keine Rolle. Die Gründe dafür liegen in der Computational Photography: Mit Mehrfach-Aufnahmen, intelligenten Algorithmen & Co. holen die Smartphones aus den kleinen Sensoren bessere Bilder heraus als ein versierter Fotograf aus einem einzelnen RAW. 2022 könnte sich das nun ändern.

Was ist RAW überhaupt?

Das englische Wort „raw“ bedeutet „roh“. Und genau das ist RAW auch: In dem Format stecken die Rohdaten vom Kamerasensor, die in der Regel gerade mal den Analog-Digital-Konverter durchlaufen haben. Bis aus diesen ein JPEG-Foto entsteht, ist noch einiges an Arbeit erforderlich – entsprechend der oft bemühte Vergleich: Das RAW-Bild entspricht dem analogen Negativ, das JPEG-Bild ist das fertig entwickelte Foto.

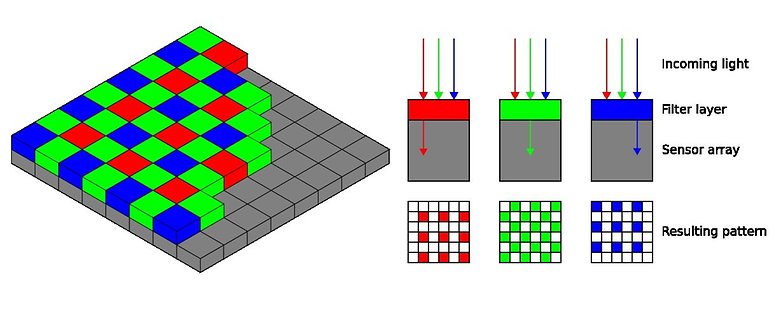

Der erste Schritt, um im digitalen Fotolabor aus einem RAW ein JPEG zu machen, ist das Demosaicing. Aus den nur roten, grünen, blauen und gegebenenfalls weißen Pixeln macht der Bildverabreitungsalgorithmus RGB-Pixel und gießt diese in einen Farbraum. Anschließend optimiert die Software das Bild mit Rauschreduktion, Nachschärfung, Objektivkorrektur, Weißabgleich & Co. – und speichert das Ergebnis als JPEG ab.

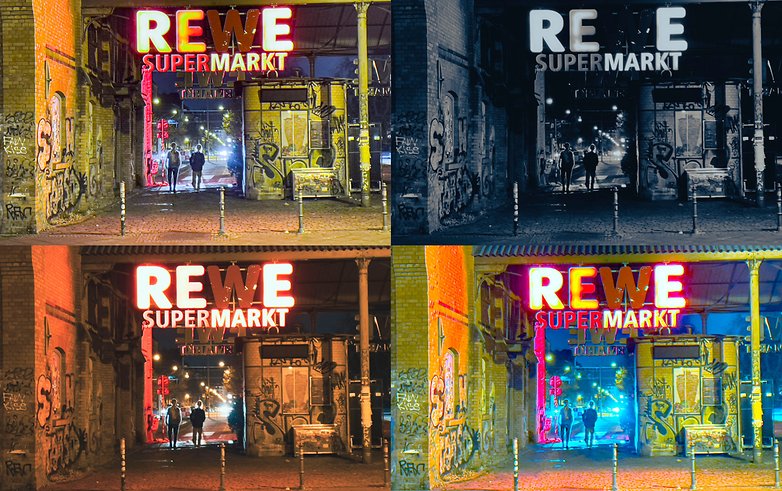

Dieser Umwandlungsprozess von RAW zu JPEG ist destruktiv und nicht reversibel, sprich: Es gehen Informationen unwiderruflich verloren. Ob das Bildergebnis nun wirklich dem Seheindruck des Fotografen beziehungsweise dem gewünschten Ergebnis entspricht, ist Glückssache – und hängt von der Qualität der Bildverarbeitenden Algorithmen ab.

Mit dem RAW-Format behält der Fotograf die Kontrolle.

Warum spielt RAW auf Smartphones keine Rolle?

Während die allermeisten Fotografen bei dedizierten Kameras RAW oder zumindest RAW+JPEG fotografieren, nutzt kaum ein Smartphone-User die typischerweise im Pro-Modus vergrabene RAW-Option. Aber wieso eigentlich nicht?

Neben der versteckten Positionierung dürfte der größte Grund sein: Weil's in vielen Fällen keinen Sinn ergibt. Während aktuelle Smartphones im AI-geboosterten JPEG-Modus gerne mal ein Dutzend Fotos in ein einzelnes Bild kondensieren, landen im RAW-Modus – meist – die Rohdaten einer einzigen Aufnahme im Speicher. Mit Hilfe der intelligenten Algorithmen holen die Smartphones heutzutage aus fünf, zehn oder fünfzehn miteinander verschweißten Fotos viel mehr Qualität heraus als ein Fotograf aus einem einzelnen RAW-Bild.

Lange Zeit war es also viel Mühe für wenig Lohn, sich mit den RAW-Dateien von Smartphones herumzuschlagen. Das könnte sich nun ändern.

RAW-Comeback 2022 als Computational RAW?

Langsam, aber sicher, setzt sich "Computational RAW" durch. Und zumindest theoretisch ist das Potenzial gewaltig, denn Computational RAW schweißt mehrere Fotos in einer einzelnen RAW-Aufnahme zusammen. So sind die Vorteile beider Welten in einem Format vereint.

Die Idee ist nicht neu. Das Google Pixel 3 von 2018 konnte bereits Computational RAW und packt die Daten von 15 Einzelbildern in eine einzige RAW-Datei. Als Größenordnung: In 15 Einzelbildern sammelt der 1/2,55 Zoll große Bildsensor vom Google Pixel 3 (ca. 23,5 mm2) so viel Licht ein wie ein Sensor im APS-C-Format (ca. 350 mm2), wie er in den meisten Mittelklasse-DSLMs steckt.

Mehr Aufmerksamkeit bekam Apple 2020 für das ProRAW-Format im OnePlus 10 Pro bringt mit RAW Plus einen entsprechenden Modus mit.

Smartphone-Apps zur Bildbearbeitung gibt's für's RAW-Format inzwischen viele – sowohl von Third-Party-Anbietern als auch von den Herstellern selbst. Und auch der Speicherhunger der Rohdatenfotos sollte im Jahr 2022 kein großes Problem mehr darstellen.

Was fehlt also noch?

Einmal ist das wohl der Mut seitens der Hersteller, das Feature prominent in der Kamera-App unterzubringen und einen einfachen Workflow für die Bearbeitung anzubieten. Sobald das steht, werden auch die Nutzer folgen, sobald sie einmal die Flexibilität der RAW-Formats selbst erlebt haben.

Was kommt als nächstes für Computational RAW?

Die nächste große Herausforderung für die Computational Photography – und damit auch für Computational RAW – besteht im Kombinieren von Fotos aus verschiedenen Kameras. Denn die Sensoren in Smartphones lassen sich nicht mehr viel weiter vergrößern, ohne die Gehäuse deutlich dicker zu machen und / oder durch optische Effekte wie selektive Schärfentiefe die Bildverarbeitungsalgorithmen zu behindern.

Der einzige Weg, die lichtempfindliche Fläche zu vergrößern, besteht im Aufteilen dieser auf mehrere Sensoren. Das Light L16 haben das bereits in den vergangenen Jahren versucht, sind aber mangels Rechenpower in den Endgeräten gescheitert. Das Problem wird sich in den kommenden Monaten und Jahren lösen – nehmt Euch also in acht, Ihr Trypophobiker.

Und Ihr so?

Wie sieht es in der NextPit-Community aus: Fotografiert Ihr schon im RAW-Format – und mit einer „richtigen“ Kamera oder sogar mit dem Smartphone? Und falls nicht: Werdet Ihr dem RAW-Format im Smartphone demnächst mal eine Chance geben?

"... Dieser Umwandlungsprozess von RAW zu JPEG ist destruktiv und nicht reversibel, sprich: Es gehen Informationen unwiderruflich verloren..."

Quatsch. Das RAW wird doch nicht gelöscht, das Ergebnis (jpeg) wird gesondert, in anderem Format, gespeichert.

"... gerne mal ein Dutzend Fotos in ein einzelnes Bild kondensieren... "

? Watt?

"... aus fünf, zehn oder fünfzehn miteinander verschweißten Fotos..."

? Büdde?

"denn Computational RAW schweißt mehrere Fotos in einer einzelnen RAW-Aufnahme zusammen."

Ist ja nichts anderes als Pixelbinning ohne klassische Entwicklung ins jpeg nach den Herstellervorstellungen.

Bis jetzt hat Pixelbinning nicht die Nachteile der kleinen

Sensoren ausgeglichen. Dann wird das "verschweißen" zu einem erweiterten RAW das problem vorerst auch nicht lösen.

RAW wird sich für endkunden nicht durchsetzen, ist auch überhaupt nicht nötig, wenn der Hersteller genug Sorgfalt bei der Jpeg-Engine walten lässt.

Das tun die Kamera-Hersteller schon lange und fahren gut damit.

Ich glaube nicht das RAW-Stacking die Lösung ist.

Das verrechnen von 5 schlechten Bildern wird nur

begrenzt Verbesserungen bringen, informationen die

nicht da sind, kann auch ein RAW nicht herzaubern.

Im Dunkeln bleibt der kleine Sensor unterlegen.

Tiefeninformationen, Infrarot und Nachsicht werden

sicher mehr zu verbesserter Qualität führen.

Ich persönlich speichere mit meinen richtigen Kameras

in RAW & jpeg. Nutze RAW aber eher selten weil mein

Hersteller eine ziemlich gute Jpeg-Engine hat.

Bei bedarf kann ich auf das RAW zurück greifen.

Längst nicht jede Kamera und jedes Smartphone speichert die RAW-Aufnahme. Gerade Smartphones im Einsteiger- und Mittelklassebereich machen das häufig nicht. Zwar brauchen sie die RAW-Aufnahme um ein verlustbehaftet JPEG-Bild daraus zu erzeugen, speichern sie aber nicht - weil dabei enorme Mengen Speicher belegt würden, und weil viele, ich vermute die meisten Nutzer kein Interesse daran haben.

Computational RAW und Pixelbinning haben nichts direkt miteinander zu tun. Pixelbinning lässt sich auch direkt mit manchen Sensoren durchführen, und dann wird eben nichts mehr per Software berechnet. Prinzipiell lässt es sich aber auch per Software realisieren und könnte in dem Fall als eine Form des Computational RAW ausgelegt werden. Es dient der Rauschreduktion bei Aufnahmen in der Dunkelheit auf Kosten der Auflösung und kann prinzipiell Aufnahmen im Dunkeln rauschärmer, solche in der Helligkeit aber mit gleichem Rauschabstand aber höherer Auflösung darstellen. Wenn es Hersteller gibt, die die Umsetzung versemmeln, spricht das nicht gegen das Verfahren an sich.

Computational RAW kann aber wesentlich mehr, als nur die Helligkeitswerte mehrerer Pixel zu mitteln.

So kann es z.B. mehrere Aufnahmen mit unterschiedlichen Kameraeinstellungen, insbesondere Belichtungszeiten, zu einer HDR-Aufnahme kombinieren.

Aus mehreren Aufnahmen lässt die Bewegungsunschärfe je nach Wunsch heraus- oder hineinreichen usw.

Ich stimme Dir allerdings in der Einschätzung zu, dass die Bildnachbearbeitung von RAW-Aufnahmen vermutlich kein Massenphänomen wird, sondern Profi- und sehr ambitionierten Hobbyfotografen vorbehalten sein wird.

Die Bildbearbeitungsprogramme sind häufig teuer, manche erfordern sogar hohe monatliche Abogebühren.

Ihre Bedienung ist nicht trivial und die Bildnachbearbeitung kann sehr zeitaufwändig sein.

Da man ohnehin viele Aufnahmen einer Situation machen kann, und missratene Aufnahmen einfach aussortieren kann, und für die künstlerische Aufbereitung der Aufnahmen weit mehr als die Software und die Fähigkeit sie zu bedienen erforderlich ist, dürfte die Nachbearbeitung der Aufnahmen die Ausnahme bleiben.

Möglich wäre natürlich, dass aufgrund größerer Speicher und schnellerer Netze zukünftig RAW-Aufnahmen häufiger direkt verwendet werden, um die Kompressionsartefakte der JPEG-Komprimierung zu vermeiden. Bei vielen günstigen Kameras dürften aber auch die nicht das größte Problem sein.

Finde Expert Raw super, aber nur zum manuellen Einstellen z.b beim Teleobjektiv.

Was man auch nicht vergessen darf, die Algorithmen werden auch kontinuierlich immer besser.

Habe auf meinem s21u in der Gallerie eine neue Vorschlagsfunktion zur verbesserung von Bildern.

Naja ich war beeindruckt, da wirklich jeder Vorschlag in meinen Augen, tatsächlich eine Verbesserung war.

Vorgeschlagen wurden viele alte Bilder und interessanter weise viele Iphone Fotos die mir vor kurzem von einem 12pro geschickt wurden. ?

Die Ki Bildüberarbeitung ( unabhängig von der Szenenoptimierung ) gibt es nun etwa ein halbes Jahr.

Je nach s21u Foto, sieht es nach der Ki überarbeitung manchmal besser aus und manchmal nicht.

Aaber die Trefferquote bei vorgeschlagenen Bildern die verbessert werden können ist enorm hoch.

Unter jedem Bild steht auch, was die Ki verbessern will, Belichtung, Auflösung, schärfe, unschärfe, belichtung, unglaublich viel.

Habe es jedenfalls bis jetzt noch nie erlebt das ich selber die Vorschläge auch jedes mal wirklich als besser empfunden habe.

Naja sowas wird in hoher Geschwindigkeit immer besser, deshalb finde ich es fraglich ob Mehrfach Raws wirklich der Hit werden?

Ich selber brauche die Expert Raw App jedenfalls nur um alle Objekte optional manuell einstellen zu können, was mit der Standart Kamera App nicht geht.

-

Admin

-

Staff

19.01.2022 Link zum KommentarJa, bin ich ganz bei Dir – es ist echt spannend, wie sich das entwickelt! Allerdings hat auch jede nachträgliche und zukünftige Bildoptimierung deutlich mehr Möglichkeiten, wenn sie nicht nur auf ein vernudeltes JPEG-, sondern auf die RAW-Daten zugreifen kann.

Aber klar, mit dem zusätzlichen Speicherbedarf wird man leben müssen – und mehr Speicher bedeutet auch langsamere Backups in die Cloud, langsamere Serienbildaufnahmen oder bei Apple beispielsweise keine gleichzeitigen Live-Fotos.

Ich denke auch "computational RAW" wird auf Smartphones eine winzige Nische bleiben. Die Leute fotografieren mit Smartphones einfach schnell was und das wird meistens überhaupt nicht bearbeitet. Ganz zu schweigen von länger dauernder Detail-Arbeit etc.

Wer sowas macht, wird wahrscheinlich in der Regel auch eine DSLR oder DSLM besitzen, aus der man doch noch mal einiges mehr holen kann. Auch wenn ein Smartphone mit 15 Einzelbildern in der Theorie ähnlich viel aufnimmt.

-

Admin

-

Staff

19.01.2022 Link zum KommentarIch frage mich, ob ich da ein Sonderfall bin. Bis Ende 2019 habe ich wirklich in jeden einzelnen Urlaub eine Kamera-Tasche mit DSLR und mind. zwei Objektiven mitgeschleppt. Im November 2019 war ich dann das erste mal "blank" im Urlaub und hab mich echt komisch gefühlt – im Nachhinein gab's aber echt sehr wenige Motive, wo ich meine DSLR vermisst hätte.

Inzwischen fotografiere ich privat nur noch mit dem Smartphone – und bearbeite die Fotos auch auf dem Handy. Was mir hier allerdings fehlt, sind noch die Workflows für die RAW-Bearbeitung und die Integration.

Aktuell nutze ich ein iPhone 13 Pro, bei dem es echt leicht ist, den RAW-Modus zu aktivieren. Allerdings geht dann Live-Photo nicht, und im Alltagsbetrieb finde ich das Feature praktischer, weswegen ich RAW viel zu wenig nutze. Am liebsten wäre mir beides gleichzeitig ;-)

Wenn es aber abseits vom höheren Speicherbedarf keine Nachteile beim Knipsen in Computational RAW gibt, dafür aber mit den Bordmitteln und guter Integration Zugriff auf die viel besseren Bearbeitungsmöglichkeiten von RAW, sehe ich nicht, wieso das nicht viel mehr User nutzen sollten.

Bist du sicherlich.

Du bist auch der einzige mir bekannte, der Live Photo gut findet... ? Apple hat seit der Einführung von Live Photo 2013 quasi nichts mehr damit gemacht und das sieht man. Die Qualität aller Bilder abseits des Hauptbildes ist kompletter Schrott, die Effekte sind sehr limitiert etc.

Würde das am liebsten komplett dauerhaft deaktivieren - mich nervt allein schon der dauerhaft eingeblendete Button in der Kamera-App enorm. Hätte da lieber irgendwas anderes wie Filter, Belichtung o.Ä.

-

Admin

-

Staff

19.01.2022 Link zum KommentarEcht – nutzt du ein aktuelles iPhone? Ich hab beim iPhone 13 Pro die Qualität der verschiedenen Bilder abseits vom Hauptbild jetzt nicht mit der Lupe verglichen, aber zumindest auf der üblichen Social-Teilen-etc.-Größe sehe ich keinen Unterschied und hab schon oft damit bei Fotos den Gesichtsausdruck korrigiert. Werd ich aber beizeiten mal unter die Lupe nehmen ;)

Und auch die eine oder andere schöne Langzeitbelichtung ist bei Live-Fotos rumgekommen sowie diverse sehr lustige Loops.

Ich nutze das 11 Pro Max, hatte aber auch schon das 12.

Und ich hab‘s es zig fach ausprobiert. Die anderen Bilder neben dem Hauptbild haben in der Regel eine Auflösung von um die 1600x1200 - teilweise sogar niedriger, manchmal etwas mehr. Und da sieht man mMn einfach deutlich. Jedes mal wenn ich auf ein Mit Live Photo aufgenommenes Bild gedrückt halte, fällt die Qualität bei dem "Video" enorm ab.

Und das finde ich einfach schade, weil die Geräte heute locker in der Lage dazu sein sollten, diese kurzen 3sek mit voller Auflösung und 20-30fps aufzunehmen. Oder einfach mal neue Effekte etc. Aber nein, es wird absolut gar nichts gemacht.

Ich nutze Live Fotos immer! Gerade wenn man ein Kleinkind hat gibt es nichts besseres und das war auch ein Grund was mich beim S21 Ultra gestört hat weil es bei Apple funktioniert und die Qualität besser ist. Es gibt also mehr Leute die es gut finden ;-)

Und nein die Qualität ist nicht "kompletter Schrott"^^ Vielleicht bei deinem 11 Pro Max, aber das hatte ich auch mal und da war es auch gut.

-

Admin

-

Staff

19.01.2022 Link zum KommentarIch mag Live Fotos auch sehr gern, so kann man "spezielle Momente" einfach gut festhalten :)

@paganini

Die Qualität war auch beim 12 Mist...

Bzw. für mich ist die Qualität Schrott. Also doch, ist sie. Die Bilder sind deutlich niedriger aufgelöst und die generelle Bildqualität ist wie Tag und Nacht, einfach weil Deep Fusion, HDR etc. außer beim Hauptbild quasi nicht angewendet werden.

@Pagani, kannst doch Serienschüsse machen ohne qualitätsverlust?

Was wäre da der Vorteil von life Foto?

Genauso kannst du in 8K Filmen und daraus Fotos nehmen?

Ich Persöhnlich würde dann eher ein Serienbild machen, dann klappt es auch mit der Qualität...

-

Admin

-

Staff

19.01.2022 Link zum KommentarDie Live-Fotos sind (wenn man sie denn aktiviert) mit ihren Möglichkeiten eben immer da. Und wenn man beim Fotografieren nicht gerade gesehen hat, dass die Person vor der Kamera die Augen zu hatte, dann wählt man hinterher eben einfach den Nachbarframe aus. Das gleiche gilt für Langzeitbelichtungen, Mini-Video-Loops, etc. – man muss während des Fotografierens nicht drüber nachdenken, hat aber hinterher noch alle Möglichkeiten ;) wenn's jetzt noch RAW wäre, hätte man eben noch mehr Möglichkeiten – aber klar, dann landen irgendwann für jedes Bild 50, 100 oder noch mehr MB im Speicher.

@Tim

Nur weil du sagst sie sind Mist sind sie nicht für alle Mist, oder stimmst du dir selbst zu? „Also doch, ist sie“ :P (wenn man Kinder hat und die Funktion schätzt), also bitte nicht verallgemeinern. Wenn du so auf Qualität aus bist würde ich kein 3 Jahre altes iPhone nutzen sondern das neuste da sehen die Live Bilder auch nochmals besser aus ;-) und Qualität ist so ein Thema, manche sagen ja auch dass 12MP bei jedem Licht besser sind als 108MP und mehr Details haben ^^

Jeder kann hier also bitte selbst bestimmen ob die Qualität für einen gut ist oder nicht.

@Olaf

Der Vorteil ist das ich auch ein kleines Video und Ton habe. Wenn ich die kleine z.B beim Schaukeln fotografiere kamen schon viele schöne kleine Live Bilder dabei raus weil sie nebenbei was gebrabbelt hat