Der Geist in der Maschine: Smartphone-Chips mit Künstlicher Intelligenz

Mittlerweile muss ein Smartphone den Stempel "KI" tragen, um in der Spitze mithalten zu können. Ein wichtiger Baustein davon ist der Prozessor. Es gibt bereits eine ganze Reihe von Smartphone-Chips mit eingebauter Künstlicher Intelligenz.

- Künstliche Intelligenz gegen Krankheiten: Der Maschinendoktor

- Engel links, Teufel rechts: Die zwei Seiten der Künstlichen Intelligenz

Sprint direkt zu:

Aktuelle

Apple A12 Bionic

Neue iPhones, neuer Prozessor - und im Jahr 2018 mit einer Extraportion Künstliche Intelligenz. Im Apple A12 Bionic steckt die zweite Version der Neural Engine von Apple, die nun mit stolzen acht Kernen aufwarten kann, die 5 Billionen Operationen pro Sekunde ausführen können. Apple nutzt die KI-Power neben der Kamera vor allem für die Gesichtsentsperrung und Augmented-Reality-Aufgaben.

- Rechenkerne: 2xVortex, 4xTempest

- Taktfrequenz: max. 2,49 GHz

- GPU: Quad-Core, eigenes Design

- NPU: acht Kerne

Hisilicon Kirin 980

Chip-Hersteller Hisilicon gehört zu Huawei und stellte im September auf der IFA in Berlin den ersten 7-Nanometer-Prozessor vor, der mit einer Dual-NPU (Neural Processing Unit) ausgestattet ist. Diese Machine-Learnung-Einheit kann 4.500 Bilder pro Minute analysieren und hilft so ungemein bei der Objekterkennung über die Kamera, die nun auch in Echtzeit bei Videos funktioniert.

- Rechenkerne: 4xCortex A55, 4xCortex A76

- Taktfrequenz: max. 2,6 GHz

- GPU: Mali-G76

- NPU: Dual-Core

Kommende Prozessoren

Samsung Exynos 9820

Mit dem Exynos 9820 wird Samsung Anfang 2019 ebenfalls einen Chip mit KI-Technologie präsentieren, wohl wie beim Kirin 980 mit einer Dual-NPU. Wie die genau aussehen wird und welche Eckdaten der Exynos 9820 haben wird, ist noch nicht bekannt. Bei Samsung dürfte die KI unter anderem dem eigene Sprachassistenten Bixby zugute kommen.

Qualcomm Snapdragon 855

Smartphone-Prozessor-Marktführer Qualcomm hat bisher keinen Prozessor mit eigener NPU zu bieten, stattdessen nutzen die Snapdragon-Chips die GPU für KI-Aufgaben mit. Das ist jedoch weniger effizient, und deshalb ist damit zu rechnen, dass der Snapdragon 855 ebenfalls eine eigene Rechenheit für Machine Learning besitzen wird.

Frühere Modelle

Apple A11 Bionic

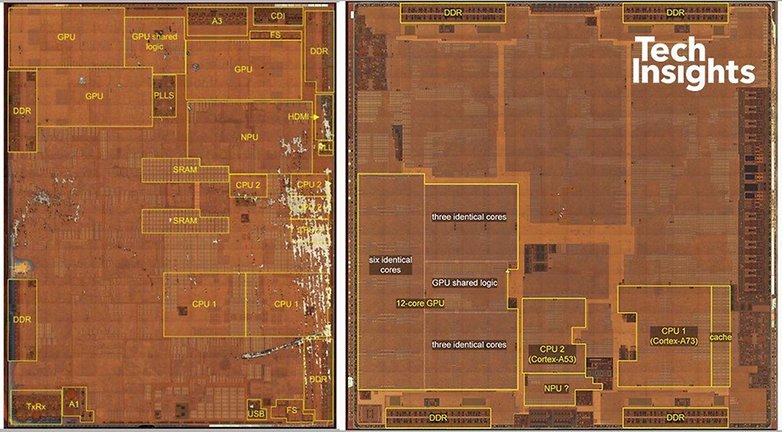

Mit dem Wechsel vom Fingerabdrucksensor zu FaceID im iPhone X setzte Apple beim A11 Bionic erstmals auf einen Smartphone-Prozessor mit Künstlicher Intelligenz. Die war unter anderem notwendig geworden durch die Gesichtserkennung, die extrem schnell und zuverlässig und ohne Internetverbindung funktionieren muss. Die Neural Engine auf dem A11 Bionic ist so groß wie mehrere CPU-Kerne.

- Rechenkerne: 2xMonsoon, 4xMistral

- Taktfrequenz: max. 2,39 GHz

- GPU: Triple-Core, eigenes Design

- NPU: Single-Core

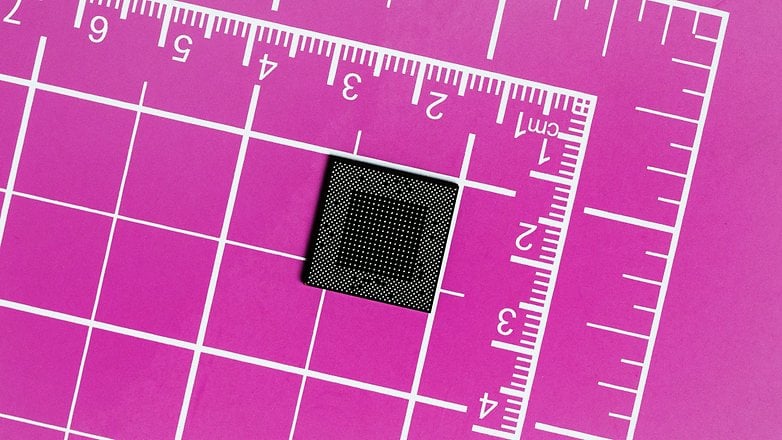

Hisilicon Kirin 970

Last, but not least: Der Pionier der schlauen Smartphone-Chips, der Kirin 970. Huawei war mit dem Prozessor von Hisilicon der erste Hersteller, der einen Chip mit eigener NPU für Machine-Learning-Aufgaben verbaute. Keine schlechte Idee, schließlich profitierten Geräte wie das Huawei Mate 10 Pro massiv von der neu gewonnen Rechenpower, die schon im vergangenen Jahr hauptsächlich der Kamera zugute kam.

- Rechenkerne: 4xCortex A53, 4xCortex A73

- Taktfrequenz: max. 2,36 GHz

- GPU: Mali-G12

- NPU: Single-Core

-

Mod

09.11.2018 Link zum KommentarInteressanter Artikel. Ich warte auch auf das erste Unternehmen, welches eine brauchbare KI entwickelt, die an die eines Lebewesens rankommt.

Erster Absatz zu Hisilicon Kirin 980: "Machine-Learnung-Einheit"... Ist das ein Tippfehler oder stiller Protest gegen Anglizismen :)

Ich musste ja bei Samsung ein bisschen schmunzeln. Der Chip soll Bixby zugute kommen, die kriegen es aber nicht mal gebacken den Sprachassistenten auf deutsch zu veröffentlichen.

Sorry, aber ein Unternehmen welches in Südkorea agiert, und in Asien sowie in den USA mit Abstand den stärksten Markt hat, hat vielleicht nicht als allererstes Ziel die Deutschen im weit entfernten Europa mit einzubeziehen.

Dass die deutsche Sprache nicht dabei ist, hat absolut nichts mit der generellen Qualität von Bixby zu tun.

Keine Ahnung wieso wir immer glauben dass unser kleines Land der Mittelpunkt der Welt sein muss.

Es schade finden oder sich darüber beschweren kann man gerne.

Aber zu sagen dass Bixby schlecht sei, nur weil es halt die deutsche Sprache nicht anbietet (auf Englisch durfte ich es schon ausprobieren und es lief echt rund), ist ein wenig vermessen mE.

Europa und Deutschland gehören mit zu den wichtigsten Märkten für Samsung. Da gehört das dazu von Anfang an Deutsch als Sprache zu integrieren.

Ja, Karsten, Europa ist bestimmt ein wichtiger Markt. Aber aufgeteilt auf jede Menge verschiedener Märkte mit verschiedenen Sprachen.

Da gehen die USA natürlich vor. Dort habe ich mit einer Sprache sofort einen riesen Markt erschlossen.

Und in Asien habe ich ja schon mit Chinesisch einen riesen Markt erschlossen. Deutschland hat 80 Millionen Einwohner, von denen nicht alle wirklich Deutsch sprechen. Vernachlässigbar.

Nö, kein Geist in einer Maschine oder in einem Chip, nur doofes Machine Learning, was ja grundsätzlich nicht verkehrt ist, aber für mich nichts was mich jetzt vom Hocker reist. Ich möchte auch eine KI die alles aufzeichnet .... wird eh schon viel zu viel aufgezeichnet und wenn Daten da sind, verarbeitet sie auch einer, der nicht unser bestes im Sinne hat, sondern nur sein bestes. Ist menschlich und daher verstänlich, aber nicht akzeptabel.

Für eine richtige K.I. bräuchte es tatsächlich nicht viel. Eine Art Datenbank die Alles aufzeichnet sprich alles was passiert mit den gegebenen Möglichkeiten so wie beim Mensch die Sinnesorgane festlegen wie viel wir registrieren und ein Algorithmus der Informationen verarbeitet und re-interpretiert. Der Basis Teil ist eben wie bei einem Baby, sprechen, lesen, rechnen und weitere Grundinformationen müssen erst einmal erschaffen werden um je nach Alter priorisiert werden, je nach dem wie oft eine Informationen logisch richtig zugeorndet wird desto mehr formt man Sie durch mehrere chronisch geordnete Versionen dieser Informationen, im Prinzip werden ältere re-interpretionen nie tatsächlich gelöscht sondern existieren als sogenanneter Schatten der aktuellen Information und formen eben diese aktuelle Info. Wie diese Zuordnung letztendlich aussieht hängt vom Umfeld ab welches diese Datenbank speist. Ein Kind Beispielsweise sieht 2 Personen miteinander reden, diese benutzen ihm unbekannte Worte und Mimiken, hier beginnt der Moment in dem gleichzeitig verzeichnet und gegebene Informationen immer wieder re-interpretiert werden. So existieren die ersten Eindrücke bereits in einer sogenannten Alpha und immer wenn eine ähnliche Situation eintritt wird dieser Baustein in der vorhandenen Datenbank gesucht und mit einer weiteren Version dieses Bausteins gespeist, praktisch eine weitere Verkettung weiterer Infos.

So wie meine Vorredner schon sagten, das was die Hersteller aktuell tun ist eine Imitation einer Intelligenz, hier arbeitet etwas nur auf Basis vom Musterinformationen diese werden vom Chip weder re-interpretiert noch wirklich analysiert.

In Deinem letzten Satz liegt aber das Kernproblem.

Es reicht eben nicht jegliche Daten aufzuzeichnen und diese irgendwie zu interpretieren, da der Mensch eine bestimmte Art und Weise zu denken als Intelligenz bezeichnet.

Vielleicht ist das was wir als intelligent bezeichnen bei anderen Wesen dieses Universums pure Ignoranz.

Aber die Frage nach der Definition von Intelligenz führt gerade zu weit (obschon sie hoch interessant ist).

Ich glaube dass die Maschine Daten so interpretieren muss wie ein Mensch um als Intelligenz wahrgenommen zu werden.

Wenn eine Kriegsmaschine welche angegriffen wird sich immer selber erschießen würde, würden wir diese als dumm oder nutzlos bezeichnen, vielleicht hat aber doch ein komplizierter Algorithmus die Daten analysiert und die beste Lösung für das Kollektiv gesucht (für Freund UND Feind).

Da sie sich infolgedessen nicht in der Lage gesehen hat den Gegner zu töten brachte sie sich selber um, um den Schaden im Kollektiv zumindest zu minimieren.

Finde das Beispiel, welches sicher an einigen Stellen hinkt, zeigt schon auf dass es immer auf die Art und Weise der Interpretation von Daten ankommt, ob wir diese als Intelligent oder nicht bezeichnen würden.

Und da liegt auch die Schwierigkeit.

Es geht nicht darum die Daten irgendwie zu interpretieren sondern diese eben mithilfe von anderen Bausteinen also Datensätzen zu vergleichen und so in unendlichen Prozessen zu re-interpretieren. Eine eigentliche Definition von logischem handeln gibt es nicht, genauso ist ein sogenannter IQ Test obsolet in Anbetracht dessen dass sich hier eben alles nach einem vorgegebenem Muster richtet. In einer Intelligenz gibt es sowas wie Logik nicht als Muster sondern diese richtet sich letztendlich aus den bestehenden Informationen aus ganz vielen verschiedenen weiteren Daten und Faktoren.

Solange kein positronisches Gehirn verbaut ist kann man nicht von künstlicher Intelligenz reden.

Steffen... Sorry, ich sage das hier zum 100. Mal, aber das ist keine KI.

Das möchte uns die Werbung dieser Hersteller mit ThinQ und Konsorten und dem Verbau einer sog NPU suggerieren, aber es ist keine künstliche Intelligenz.

In der Informatik wird seit Jahren an richtiger KI geforscht. Nur weil jetzt die Mobilfunk Hersteller diesen Namen für sich entdeckt haben und er rechtlich nicht abgrenzbar geschützt ist, ist es noch lange nicht richtig.

Was wir hier haben ist eine Nachahmung von Intelligenz durch simple aber miteinander arbeitende Algorithmen, nicht aber eine offene Entscheidungsstruktur, die auch nur Ansatzweise mit der eines Menschen vergleichbar wäre.

Ich wette, der Steffen und die Leser hier wissen das.

"KI" ist halt schneller geschrieben als "eine Nachahmung von Intelligenz durch simple aber miteinander arbeitende Algorithmen, nicht aber eine offene Entscheidungsstruktur, die auch nur Ansatzweise mit der eines Menschen vergleichbar wäre"

Recht hast du natürlich trotzdem.

Diese Namensgebung wird aber wohl leider so bleiben.

Es sei denn, wir finden eine bessere Abkürzung...

SI(smarte Intelligenz) oder so...

II-Imitated Intelligence ?

Auf den Punkt getroffen ?

Maschine Learning = ML .... klingt natürlich nüchterner