KI-Bildgeneration: StableDiffusion & Co. lokal auf dem iPad nutzen

StableDiffusion oder Openjourney auf dem iPad, und das auch noch lokal? Mit einigen Apps klappt das ohne Probleme, vor allem wenn Ihr ein leistungsstarkes iPad Pro mit M1- oder M2-Prozessor nutzt. NextPit erklärt Euch, wie Ihr auf dem iPad KI-Bilder erstellt.

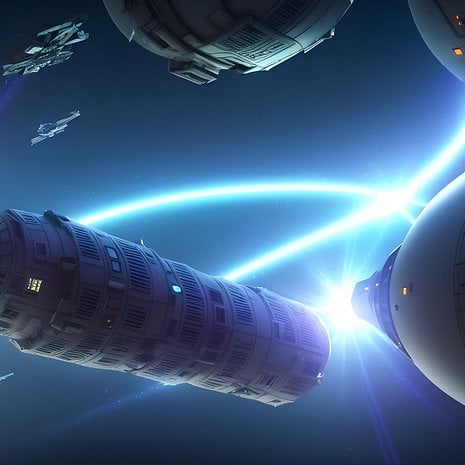

Ob im App Store, auf Instagram oder bei Reddit: Man kann derzeit kaum einen Stein ins Internet werfen, ohne ein KI-Bild zu treffen. Führte vor wenigen Monaten der einzige Weg noch über Browser-Interfaces à la Dall-E Mini, sind inzwischen unzählige KI-Modelle frei verfügbar und generieren wirklich alle Arten von Bildern.

Als StableDiffusion & Co. im vergangenen Herbst durch die Decke schossen, war die Bildgeneration alles andere als nutzerfreundlich. Man brauchte ein User-Interface à la Automatic1111 und eine möglichst leistungsstarke Grafikkarte im Desktop-Computer. Wer die passende GPU nicht hatte, konnte die Python-basierten Skipte auch über Google Colab laufen lassen, ein cloud-basiertes Framework mit quasi beliebig viel Rechenpower. Oder man bezahlt eben bei Midjourney, ist dann aber auf einen relativ speziellen Bildstil festgefahren.

Wie kommt jetzt StableDiffusion aufs iPad?

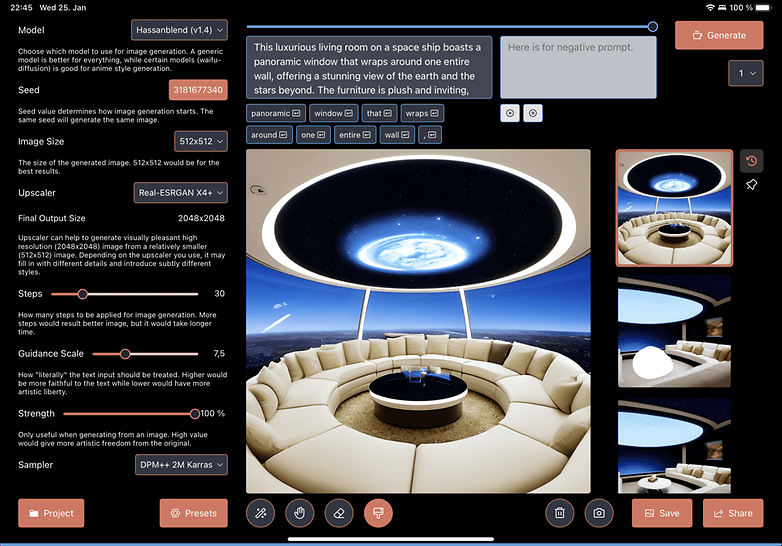

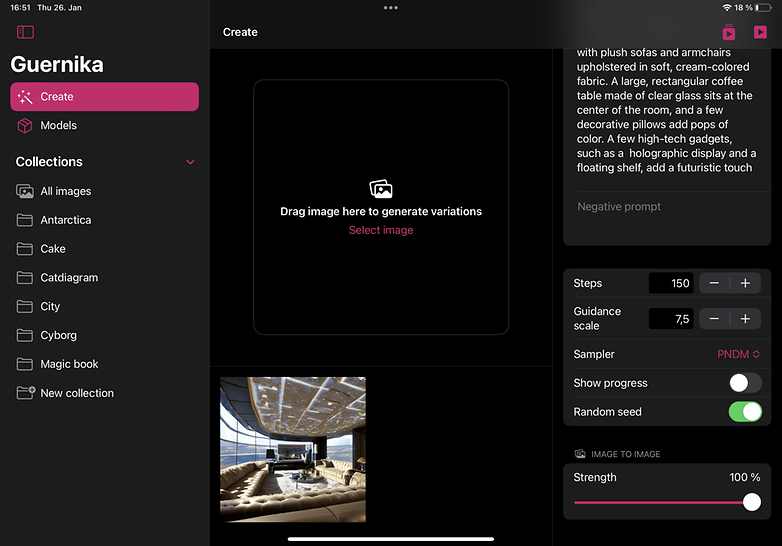

Mit der Zeit hat die Rechenleistung abgenommen, die fürs Generieren von KI-Bildern erforderlich ist. Statt nur auf Hochleistungsrechnern oder in der Cloud klappt das Generieren von KI-Bildern inzwischen auch auf dem iPad beeindruckend gut. Wir haben dazu auf dem iPad Pro (2022) mit M2-Chip zwei verschiedene Apps ausprobiert, beide mit ihren Stärken und Schwächen: Guernika und Draw Things.

- Draw Things für iPadOS herunterladen: Apple App Store, kostenlos

- Guernika für iPadOS herunterladen: Apple App Store, 2,99 Euro

Beide Apps sind lediglich eine GUI für das Generieren von Bildern mithilfe eines Modells. Und beide Apps bieten von Haus aus eine Liste von Bild-Modellen, die Ihr herunterladen könnt. Hier wie dort finden sich StableDiffusion in diversen Versionen sowie Openjourney, die Open-Source-Alternative zu Midjourney. Draw Things hingegen bietet eine ausgiebige Liste von Disney über Anime bis SuperMario.

Sowohl bei Draw Things als auch bei Guernika könnt Ihr auch eigene Modelle laden. Diese Bildmodelle werden immer als .CKPT-Dateien geteilt. Das Kürzel steht für Checkpoint und bezeichnet einen als Datei eingefrohrenen "Denk"-Zustand eines Machine-Learning-Modells. Im Netz gibt es unzählige Quellen für alle nur erdenklichen Modelle.

Welche Einstellungen sind wichtig?

Abseits des Modells findet Ihr in den beiden Apps eine Reihe von Einstellungen, die sich zu weiten Teilen überschneiden. Besonders wichtig sind hier natürlich die Prompts sowie die "Steps" und die "Guidance Scale".

Der Prompt ist die Text-Anweisung, aus der das KI-Modell das Bild generiert. Das klingt zunächst einfacher, als es ist – denn für gute Ergebnisse im gewünschten Stil sind oft komplexe Prompts erforderlich. Außerdem könnt Ihr über negative Prompts auch bestimmte Bildstile, Bildwinkel oder Dinge ausschließen. Aber auf Prompts kommen wir weiter unten noch einmal gesondert zu sprechen.

Die Steps bezeichnen, mit wie vielen Arbeitsschritten das Bild generiert wird. Mehr Arbeitsschritte bedeuten grundsätzlich mehr Qualität – allerdings auch mehr Rechenzeit. Je nach verwendetem Modell liefern unterschiedlich viele Schritte gute Ergebnisse. Die Guidance Scale legt fest, wie weit das Modell von Euren Prompts abweichen darf. Ein niedriger Wert erlaubt der KI hier mehr "künstlicherische Freiheit".

Sowohl bei Draw Things als auch bei Guernika könnt Ihr auch andere Bilder als Input geben. Dazu gibt es jeweils einen "Strength"-Slider, der festlegt, wie nah das Ergebnis am Originalbild liegen soll. Nachdem jedes generierte Bild einzigartig ist, gibt es bei Draw Things die Möglichkeit, gleich bis zu 100 Bilder in einem Schwung generieren zu lassen – Guernika bietet gar einen Endlos-Modus.

Das letzte Feature schließlich gibt es nur bei Draw Things: Hier könnt Ihr die Ausgabe-Auflösung festlegen. Guernika liefert derzeit ausschließlich Bilder mit 512 × 512 Pixeln Größe, wenngleich der Entwickler hier ein baldiges Update mit mehr Flexibilität versprochen hat. Außerdem könnt Ihr bei Draw Things noch einen KI-Upscaler hinzuschalten, der die Auflösung noch weiter hochskaliert. So könnt Ihr hier dann auch hochauflösende Bilder mit 12 Megapixeln und mehr erzeugen.

Und dann kann's auch schon losgehen! Auf unserem M2-iPad dauerte das Generieren der KI-Bilder etwa 20 Sekunden bis fünf Minuten, je nach gewählter Einstellung. Es hat sich als praktisch erwiesen, die Prompts mit sehr geringer Auflösung auf Tauglichkeit zu prüfen und dann bei vielversprechenden Ergebnissen gleich einen größeren Schwung Bilder mit hoher Auflösung zu generieren.

- Auch interessant: Alle iPads von Mini bis Pro im Vergleich

Wie kommt Ihr an die richtigen Prompts?

Das Schreiben von guten Prompts ist eine Wissenschaft für sich – und etwas, das man erst lernen und trainieren muss. Nicht umsonst finden sich auf einschlägigen Portalen bereits die ersten Jobangebote als "Prompt Engineer" – also als jemand, der Anweisungen für KIs schreibt.

Bei Euren Prompts kommt nur Müll heraus? Dann lasst Euch doch davon inspirieren, mit welchen Keyword-Kombinationen andere User tolle Ergebnisse erzielt haben. Auf Webseiten wie PromptHero könnt Ihr Euch durch KI-Kunst klicken und jeweils sehen, mit welchem Modell beziehungsweise Checkpoint und mit welchem Prompt das jeweilige Bild entstanden ist.

Übrigens könnt Ihr auch ChatGPT darum bitten, Euch für bestimmte Motive ausschweifende Prompts zu schreiben. Probiert's einfach mal aus.

- Weiterlesen: So schreibt Ihr Texte mit ChatGPT

- Mehr zum Thema im Podcast: Macht uns KI bald arbeitslos?

Was sagt Ihr generell zu KI-generierter Kunst? Findet Ihr die aktuelle Entwicklung rund um Midjourney, StableDiffusion & Co. faszinierend oder erschreckend? Oder beides? Und würdet Ihr bei NextPit gerne mehr zu diesem Thema lesen? Ich freue mich auf Eure Meinung in den Kommentaren!

Irgendwie sehen eure Beispielbilder nur wie simple Imitate aus, zum Beispiel Draw Things 01 sieht wie ein Werk von Kinkade aus und Draw Things 02 erinnert extrem an Bilder des chinesischen Mangaka Benjamin. Abgesehen davon finde ich sie in ihrer Wirkung alle seelenlos und leer, mir fehlt da was frisches, individuelles. Gerade Benjamin stellt ja gerne das in der kalten Großstadt verlorene Individuum dar, das wirkt dann aber trotz der dargestellten "Isolation" wesentlich emotionaler und anrührender als das Bild hier. Im Grunde ist das alles genauso oberflächlich und gewollt gefällig wie die Texte, die Chat GPT so produziert und damit eher Distanz als Interesse schafft.

Das Thema ist aber spannend und ich würde gerne mehr darüber bei euch lesen.

-

Admin

-

Staff

27.01.2023 Link zum KommentarTatsächlich kann man in die Prompts ja auch Namen von Künstlern reinschreiben, in deren Stil man die Bilder generieren möchte. Das verhilft plötzlich bestimmten Fotografen oder Künstlern zu unverhofftem Ruhm, beispielsweise taucht in unfassbar vielen Prompts "Greg Rutkowski" auf, weil der Name einen bestimmten, oft gewollten Bildstil provoziert. Rutkowski selbst ist davon mäßig begeistert...

Man kann ChatGPT übrigens auch befehlen, Texte in bestimmten Stilen zu schreiben. Klappt mal besser mal schlechter – und mit Grenzen. ChatGPT weigert sich partout, Rilke im Stil von Donald Trump zu schreiben :p

Ja, ich kann mir gut vorstellen, dass nur wenige Künstler es gut finden, wenn das Netz plötzlich überschwemmt wird mit Werken in einem Stil, für den der Künstler vielleicht selbst Jahre gebraucht hat, ihn zu entwickeln. Und plötzlich wird der Stil zu Massenware, an der sich das Publikum vielleicht dann auch schnell satt sieht (so zumindest geht es mir mit Rutkowski).

Hahaha, Rilke im Stil von Trump erinnert mich an Shakespeare im klingonischen Original (ein Zitat aus Star Trek, weiß aber nicht mehr welche Serie).

-

Admin

-

Staff

27.01.2023 Link zum KommentarHahaha :)

Auf Reddit hatte ich auch mal einen Beitrag von einer Künstlerin (Malerin, wenn ich mich recht erinnere) gesehen, die ein Modell auf ihren Stil trainiert hat, um neue Inspirationen für sich selbst zu generieren – das ist dann natürlich die andere, positive Seite.

erlebe es selber mit meiner streetart Kunst. machen kann man nicht viel

<<< Was sagt Ihr generell zu KI-generierter Kunst? >>>

Wer nicht fotografieren kann.... ?

Das hat doch mit Fotografieren nichts zu tun.

-

Admin

-

Staff

27.01.2023 Link zum KommentarUnd wer nicht malen kann, muss fotografieren ^^

dann es es eben keine Kunst mehr