Google Gemini Live: Mondlandung-Moment für KI-Smartphones?

In anderen Sprachen lesen:

Google hat heute gleich vier neue Smartphones der Pixel-9-Serie, eine neue Pixel Watch in erstmals zwei Größen und neue Pixel Buds vorgestellt. Während die Hardware nach einem vollen Abendprogramm klingt, ist der wahre Star ein ganz anderer: Gemini – und besonders Gemini Live. Ist das der Mondlandung-Moment für künstliche Intelligenz?

Was ist Gemini – und wenn ja, wie viele?

Einen Schritt zurück: Unter dem Dach namens Gemini vereint Google etwas verwirrend viele unterschiedliche Dinge. Einmal gibt es da die generativen KI-Modelle Gemini Nano, Gemini Flash, Gemini Pro und Gemini Ultra. Jene Modelle schreiten jeweils nach aufsteigenden Versionen fort; das aktuell mächtigste Modell ist "Gemini 1.5 Pro", das in diversen KI-Benchmarks die Konkurrenz von OpenAI & Co. hinter sich lässt.

Gemini heißt aber seit Anfang 2024 auch Googles Chatbot, formerly known as Bard. Und jener Chatbot bekommt nun eine Sprachversion namens "Gemini Live" im Stile des sagenumwobenen Voice Mode von ChatGPT 4o, der einen Tag vor der Google I/O im Mai 2024 angekündigt wurde – und immer noch nicht einmal als breite Beta verfügbar ist, dafür eher durch gruselige Ausfälle Schlagzeilen (siehe "Unauthorized Voice Generation") macht als durch einen Überraschungsauftritt.

- Mehr zum Thema: Die KI-Woche im Mai 2024 im Podcast Casa Casi, Folge 131

Achso, Gemini bezeichnet auch verschiedene Abomodelle. "Gemini" alleine ist der kostenlose Zugang zur Google-KI namens Gemini auf Basis des "Gemini Pro"-Modells. Auf das erwähnte "Gemini 1.5 Pro" habt Ihr aber nur Zugriff mit dem Abomodell "Gemini Advanced" für 21,99 Euro im Monat – oder Ihr abonniert eben Google One AI Premium. Mit Gemini Business will ich an dieser Stelle gar nicht erst anfangen. Jetzt aber zur vermeintlichen Mondlandung.

Gemini Live: Der "Star" des Abends

Abseits der vierunddrölfzig verschiedenen Geminis gibt es noch ein gleichnamiges Feature, das den Weg in die kommenden Jahre weist: Gemini Live. Dabei handelt es sich um ein sogenanntes Conversational Model, das natürliche Gespräche zulässt – und nicht einfach nur rundenbasiert Sprachnachrichten mit dem KI-Modell austauscht, die jeweils als Text transkribiert beziehungsweise per Sprachausgabe ausgegeben werden. Der Unterschied in der Dynamik ist vergleichbar mit jenem zwischen XCOM und Quake.

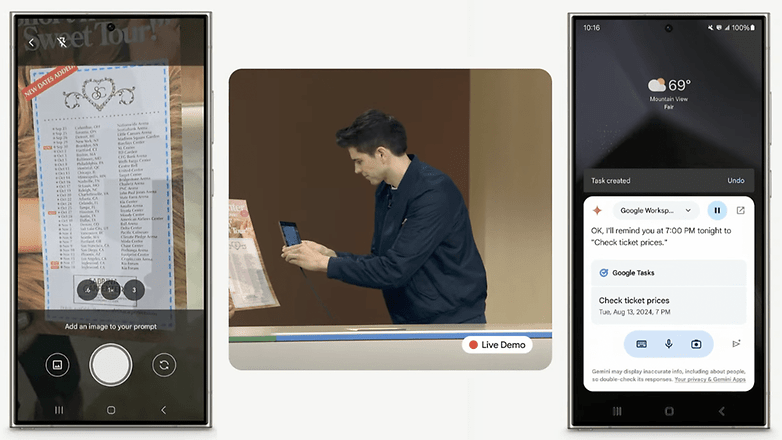

In der Live-Demo auf dem "Made by Google"-Event fragte Jenny Blackburn nach einer spaßigen und lehrreichen Beschäftigung für ihre Nichte und Neffen aus dem Bereich Chemie inklusive einem Touch Magie. Die Vorschläge waren ein Magischer Vulkan, eine selbstgebastelte Lavalampe oder unsichtbare Zauber-Tinte. Jenny wählte die Zauber-Tinte, die sich im Laufe der folgenden Konversation zu Schwarzlicht-Tinte entwickelte, den Projektnamen "Secret Message Lab" bekam und die Zusicherung, beim Experimentieren nicht übermäßig viel Dreck zu machen.

Weniger als das reine Ergebnis, das sich problemlos auch hätte googeln lassen, ist der Weg das wirklich Beeindruckende gewesen. Mit Gemini Live wird das Internet zum Gesprächspartner – und perspektivisch auch Euer eigenes Leben, das sich dank einiger neuer Features ab sofort ebenfalls per Gemini-KI durchforsten lässt.

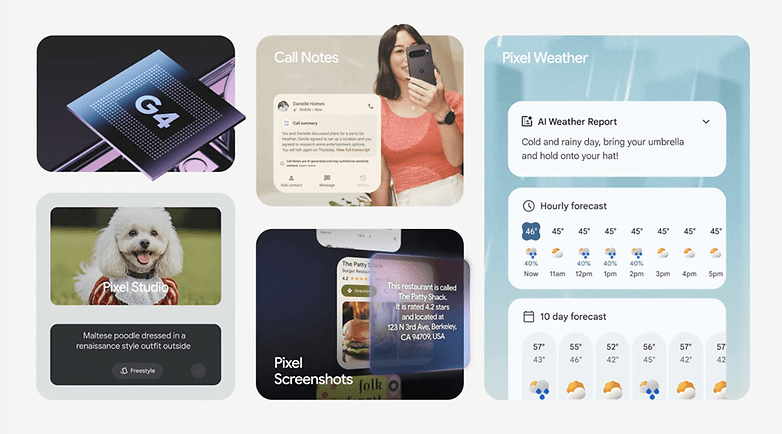

Die Funktion "Call Notes" beispielsweise transkribiert nach einem Hinweis für Euren Gesprächspartner Eure Telefonate und erlaubt es Euch, diese nachträglich zu durchsuchen. "Pixel Screenshots" verwandelt Eure verwahrloste Sammlung von Screenshots vermeintlich wichtiger Dinge in eine durchsuchbare Datenbank persönlicher Notizen. Und mit den Workspace Extensions könnt Ihr mit Eurem Google Calender sowie Euren Daten aus Mails, Tasks oder Keep sprechen.

Das "Problem": Gemini Live erfordert meinem Verständnis nach das mächtige Sprachmodell Gemini 1.5 Pro, das in der Cloud läuft. Nutzt Ihr KI-Modelle, um Details aus Eurem Universum persönlicher Google-Workspace-Daten, Transkriptionen & Co. zu extrahieren, dann geschieht das ausschließlich lokal – und zwar mit Gemini Nano. Zum Cloud-basierten Gemini 1.5 Pro klafft aber der große Datenschutz-Graben. Wir haben Google hierzu um ein Statement gebeten und werden den Artikel aktualisieren, sobald wir Feedback bekommen haben.

Gemini und der Datenschutz-Graben

Während Gemini, lateinisch für "Zwilling", eigentlich für die Partnerschaft steht zwischen Googles beiden KI-Laboren Deepmind und Brain, könnte man den Namen auch als als unfreiwillige Beschreibung der Lokal-zu-Cloud-Trennung sehen.

Klartext: Wenn Ihr ab quasi sofort auf Englisch mit Gemini Live in der Gemini-App für Android quatscht (ja, natürlich heißt die App auch so), dann hat das hier laufende KI-Modell keinerlei Zugriff auf Eure persönlichen Daten aus Mail, Kalender & Co. Und voraussichtlich wird sich das auch noch nicht ändern, wenn Gemini Live in den kommenden Wochen und Monaten dann auch in weiteren Sprachen und sogar für iOS verfügbar ist – letzteres in Europa womöglich sogar vor Apple Intelligence.

Wenn Ihr Gemini anhand eines abfotografierten Konzertplakats fragen wollt, ob Euer Terminkalender den Besuch zulässt, dann müsst Ihr wie ein Steinzeitmensch auf Buchstaben tippen statt Euren KI-Assistenten herumzukommandieren – oder den Prompt per Spracheingabe diktieren. Denn das lokal laufende Gemini-Nano-Modell hat zwar Zugriff auf Eure persönlichen Daten, dafür aber nicht ausreichend Power für Echtzeit-Konversationen.

- Auch interessant: Google Pixel 9, Pixel 9 Pro (XL) und Pixel 9 Pro Fold im Vergleich

Ist Gemini Live also die Mondlandung im "AI Race"?

Im Space Race der 60er und 70er Jahre gab es bei der NASA ein Raumfahrtprogramm namens "Gemini", das den Weg für die erste Mondlandung im Jahr 1969 mit dem nachfolgenden Apollo-Programm ebnete. Zufall? Kaum, denn die zehn für Gemini Live zum Start verfügbaren Stimmen haben mit Vega, Dipper, Ursa & Co. englischsprachige Namen für Sternenkonstellationen bekommen.

Während Google also nach den Sternen greift und in seiner After-Party auch einen Ex-NASA-Ingenieur auf der Bühne hat, fehlt aber noch ein Stück zur Mondlandung – nämlich jenes vorsichtig zu schmiedende Bindeglied zwischen den privatesten Daten der Nutzer in den lokal laufenden Gemini-Modellen und den mächtigen Cloud-Modellen, die natürlich anmutende Konversationen ermöglichen.

Mit Projekt Apollo Astra hat Google auf dem Made-by-Google-Event bereits den nächsten Schritt angekündigt: Hier soll Gemini Live wie bereits zur Google I/O gezeigt Zugriff auf die Kamera bekommen und dann auch schrittweise Apps integrieren wie den Google Calendar. Ob bis dahin Apple Intelligence ähnliche Features bietet? Das Rennen läuft!