Ein KI-System zeichnet Gesichter auf Basis der Stimme

Wir haben alle schon einmal die Stimme einer Person gehört und uns vorgestellt, wie sie wohl aussieht - mit mehr oder weniger viel Erfolg. Ein Algorithmus führt nun dasselbe Experiment durch.

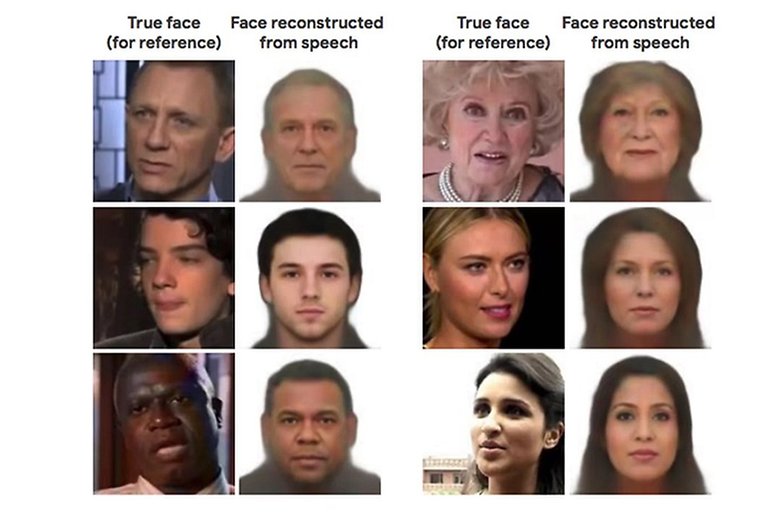

Der fragliche Algorithmus heißt Speech2Face. Eine Gruppe von Wissenschaftlern trainierte das neuronale Netzwerk mit Hilfe von Millionen von Videos, in denen mehr als 100.000 Menschen sprechen. Daraus stellt der Algorithmus Assoziationen zwischen den Stimmen und bestimmten physikalischen Merkmalen des menschlichen Gesichts her. Damit kann die KI Porträts von Menschen erstellen, von denen sie nur die Stimme kennt.

Die Forschungsergebnisse wurden am 23. Mai vorab veröffentlicht. Sie wurden allerdings noch nicht von anderen auf dem Gebiet tätigen Wissenschaftlern überprüft.

Aber wie genau funktioniert der Algorithmus? Noch ist die KI nicht in der Lage, Individuen allein anhand von Stimm-Samples zu identifizieren. Vielmehr identifiziert das neuronale Netzwerk Merkmale, die mit bestimmten Faktoren wie Geschlecht, Alter und Ethnie verbunden sind. Da diese Merkmale von einer beträchtlichen Anzahl von Menschen geteilt werden, sind die erzeugten Bilder eher ein Durchschnitt als genaue Einzelporträts.

Allerdings hat Speech2Face Porträts von erstaunlicher Genauigkeit geschaffen, aber auch gewisse Schwächen bei Variationen in der Aussprache gezeigt. So produzierte die KI beispielsweise zwei völlig unterschiedliche Porträts derselben Person, nachdem sie ihr auf Chinesisch und Englisch zugehört hatte. Das Talent des Algorithmus zur Darstellung von Menschen ist allerdings größer als zur Darstellung von Katzen.

Was meint Ihr zu dieser Entwicklung? Lasst es uns in den Kommentaren wissen.

Quelle: LiveScience

Nicht übel. Wieder ein schönes Mittel für Überwachung und Verfolgung, die machen demnächst das Fahndungsfoto sobald der Kidnapper angerufen hat.

Alter Schwede, so schlecht sind die Gesichter gar nicht...